推 vios10009: ContolNet真的神 04/03 21:29

推 jabari: 一鍵啊嘿+嘴邊毛+愛心眼 04/03 21:30

推 arrenwu: 差分看起來要的是相反的行為? 04/03 21:31

→ arrenwu: "inpaint一直局部重畫臉部"的腳本? 04/03 21:32

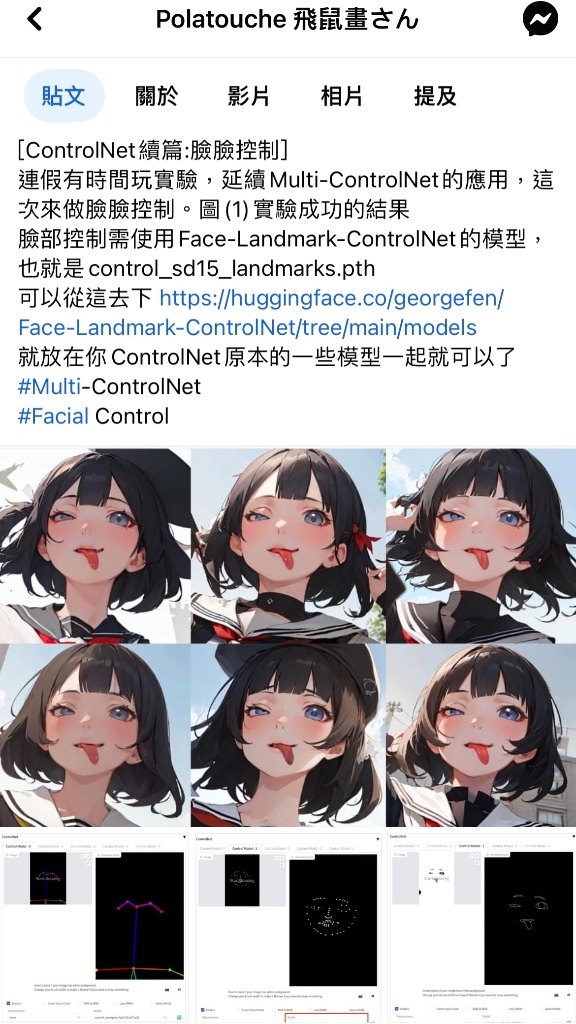

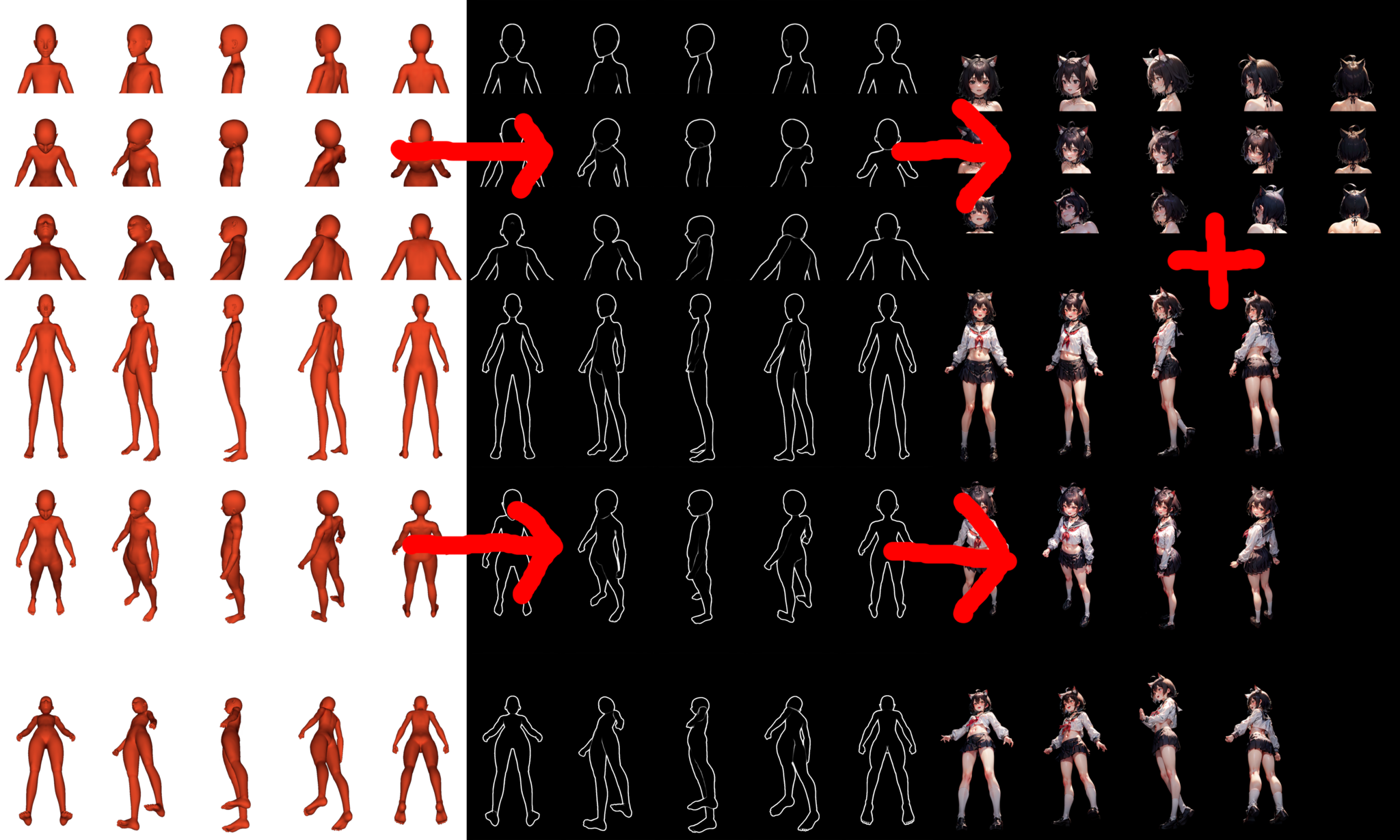

→ ZMTL: 我的想法是可能會變成一張ControlNet模板上面有喜怒哀樂各種 04/03 21:32

→ ZMTL: 表情的臉部特徵圖,然後直接出一套(像底下多視角圖一樣) 04/03 21:33

→ bluejark: 不用這個也有人做啊就直接用文字改表情的的 04/03 21:34

→ jeff0811: AI做動畫的時代快到了 04/03 21:35

→ ZMTL: 因為下面就是用一張由3D模型做成的環繞像模板,一次出同樣 04/03 21:36

→ ZMTL: 衣裝構圖的角色的方法,那把各種常見表情做成模板應該有機會 04/03 21:36

推 arrenwu: 看起來是「局部」修改的部分比較不一樣 04/03 21:37

→ arrenwu: 動畫那邊好像暫時沒看到相關的什麼進展XD 04/03 21:37

→ arrenwu: 明明動畫那邊我覺得需求還滿強的說 04/03 21:37

推 reader2714: contolNet算是大躍進的推手了吧 04/03 21:38

→ bluejark: 動畫的問題就是他每格畫的都會因為畫的有問題 04/03 21:40

→ ZMTL: 動畫之前聽人演講有提到,現在問題在v2v(逐禎i2i)的過程,你 04/03 21:41

→ ZMTL: 去壓隨機性就會轉了等於沒轉,但釋放隨機性就是不連貫閃爍 04/03 21:41

→ bluejark: 圖片很多都生一堆圖選好的貼出來就行了 04/03 21:41

→ ZMTL: 動畫要突破要一個能在整套圖片中固定隨機性的算法之類 04/03 21:42

→ bluejark: 連起來動起來你就看衣服差異就很明顯 04/03 21:42

→ ZMTL: 看專門弄動畫的Runway能不能克服技術吧 04/03 21:44

→ bluejark: 我想到一件事 現在有辨法指定色碼嗎 04/03 21:45

→ ZMTL: 我還沒聽過,有機會再注意XD 04/03 21:46

→ bluejark: 現在用文字指定顏色其實也會有色差 04/03 21:46

→ ZMTL: 就算這樣離能真的用也還有距離 04/03 21:46

推 arrenwu: 就...前期概念我覺得還不錯用啦 04/03 21:46

→ arrenwu: 直接拿出來那應該是不行的 04/03 21:47

推 v86861062: 推推 04/03 21:49

→ SALEENS7LM: 如果只是拿來協助一些初期參考資料可能有點幫助吧大 04/03 21:50

→ SALEENS7LM: 概,但也就這樣了 04/03 21:50

→ ZMTL: 結果目前動畫我看到完成度最高的除了剪刀石頭布外大概還是 04/03 21:51

→ ZMTL: 這間台灣公司的嘗試作品,不知道未來會不會有後續 04/03 21:51

→ ZMTL: (這影片已經是兩個月前了) 04/03 21:51

→ ZMTL: 哦對了,這間是台灣的動畫公司,算業界吧XD 04/03 21:52

→ allanbrook: 我還是覺得目前這種濾鏡似的東西冠上AI動畫很騙人 04/03 21:52

推 arrenwu: 那個完成度不高吧 只是問題沒有那麼明顯而已 04/03 21:53

→ arrenwu: 本質上的問題是一樣的 04/03 21:53

→ ZMTL: 我只是說這是完成度最高的,但整體完成度還是...XD 04/03 21:55

→ ZMTL: 還是先看繪圖應用吧,一件差分能出來對於RM系遊戲應該很能用 04/03 21:55

推 allanbrook: 基本上現在效果看起來越好 就只表示他們的原始素材本 04/03 21:55

→ allanbrook: 身就已經很好了 04/03 21:55

→ ZMTL: 至少我對AI動畫沒太多期待,AI 3D模型還比較有盼頭 04/03 21:56

推 arrenwu: 應該說,那個跟上面妳貼的KPOP 動畫MV我覺得是差不多的 04/03 21:56

→ arrenwu: 不知道有沒有什麼方向是可以加速原畫的 04/03 21:57

→ arrenwu: 這個如果能加速 會直接幫助到現行的動畫產業 04/03 21:58

→ bluejark: 像上面提的能指定色的話那AI上色理論就能自動化了 04/03 22:07

推 x2159679: 不過有一個問題是指定上色使用者上的色會比ai好看嗎 04/03 22:08

→ x2159679: ai可以說已經是把上色能力練到極致了 04/03 22:08

→ x2159679: 像一堆圖ai都已經自己預設做好冷暖對比了 04/03 22:09

→ bluejark: 像我們看的動畫都有指定色票啊才不會每個人上得不一樣 04/03 22:10

推 allanbrook: 講速度還可以 講好看你太小看人類了吧 04/03 22:12

推 arrenwu: 上色這個比較沒有絕對的好看指標就是了 04/03 22:13

推 momoden: 每次都說大概只能這樣 然後它就進化了 04/03 22:16

推 showwhat2: 上色指標請找色彩學,現在AI的上色能力取決於模組和濾 04/03 22:20

→ showwhat2: 鏡,現在不知道有沒有上色插件可以用。 04/03 22:20

→ bluejark: 觀眾還是人啊不然AI動畫有那種像是有嗑藥的那種 04/03 22:21

推 HotDogCC: 有沒有人用DLSS3搭配model來生動畫,蠻想看的 04/03 22:21

→ cybermeow: 我還在等哪個圖片平臺會先把ai差分接上去 04/03 22:59

→ cybermeow: 文字的像是notion都接了 圖片的目前感覺還是分成兩塊 04/03 23:00

→ SALEENS7LM: 上色跟其他繪畫成份一樣,沒有絕對,我純手工派當然 04/03 23:17

→ SALEENS7LM: 最喜歡也只能接受人親自去上色,尤其是米山舞、Mika 04/03 23:17

→ SALEENS7LM: Pikazo或LAM的,超讚der 04/03 23:17