噓 ken1990710: 人的資料庫是文化從無到有一代一代傳承下來的,而且03/04 11:21

→ ken1990710: 懂得這些資料內涵意義是什麼,Ai只是無腦的拼湊人給03/04 11:21

→ ken1990710: 的資料,連資料內容都不懂能談上什麼創意,而且Ai自03/04 11:21

→ ken1990710: 己也不能判斷什麼叫創意,差這麼多你也能來嘴喔03/04 11:21

→ SALEENS7LM: 一個連自我思考、人格意識、基本情感都沒有,只能依03/04 11:21

→ SALEENS7LM: 靠資料庫去機械式回答的弱Ai,的確不會創作也沒有創03/04 11:21

→ SALEENS7LM: 意,真要像vivy 那樣真的會創作,已經是非常遙遠的未03/04 11:21

→ SALEENS7LM: 來,Ai進化到非生物人類的時候了03/04 11:21

雖然說我之前說過不要把ChatGPT當搜尋引擎用,

不過ChatGPT aka GPT3.5 aka 現代主流的自然語言處理(NLP)模型

倒也不是這麼沒用的「無腦拼湊」、「機器式回答」...

這大概是1950~1980年代自然語言模型就在做的事情。

1980~2000年左右NLP開始會用統計的方式去推那分析,

2000年以後現在真的在「模擬思考」,用的是類神經網路+機械學習的方式,

電腦已經有能力去「推測」他從來沒學過得內容並去做出回應了。

(對於NLP的部分可以參考:

https://aiacademy.tw/what-is-nlp-natural-language-processing/

不過這篇只提比較多是台灣/中文,有興趣我可以去翻我這個禮拜看的一疊國際論文出來)

很多人以為ChatGPT給錯誤的答案是因為他拼到網路上錯誤的資料,這就是誤解,

只是因為他沒有這樣的資料,所以他基於他學習過的內容「做出推測」所以才是錯誤的。

然後對於ChatGPT到底好不好用呢?

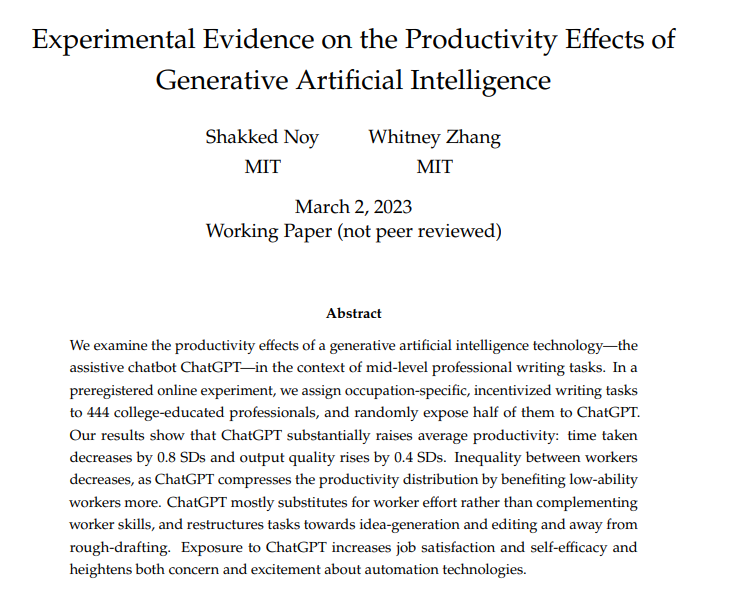

這是前幾天麻省理工的研究論文(請恕我在工作還沒時間看)

https://images.plurk.com/6aKwK6j6oeCTcRDoL4qijc.png

→ astinky: 因為AI被吹太兇了,一般人認知的合格AI不會犯錯 03/05 16:38

→ bnn: 蒸汽動力取代的主要是獸力算勞工整體生產力(? 03/05 16:40

→ bnn: 然後需要增加人去挖煤是新的生產力(? 03/05 16:40

→ bnn: 而ChatGPT提供的取代大概是腦力的勞動力取代 不是身體勞動 03/05 16:42

推 clarkyoona: Ken的臉還好嗎? 03/05 19:27