推 NDark: 這很合理啊 盡信書不如無書 08/29 21:00

→ NDark: 操作股票 收到不同訊號的時候到底要信誰的 08/29 21:01

→ NDark: 所以要有更高等的指引 08/29 21:01

→ NDark: 類似 機器人三大法則 08/29 21:02

→ NDark: 當事實矛盾的時候 智能就應該回到更高等的概念重新推導 08/29 21:02

→ NDark: 然後找到一個不完美但相對合理的結論 08/29 21:03

→ Suleika: 說實話rot議題一直很奇怪,因為太長所以被干擾,不是因 08/29 21:06

→ Suleika: 為context太多雜訊才rot嗎,window直接影響理解跟記憶 08/29 21:07

→ Suleika: 看起來才是根因 08/29 21:08

→ shadow0326: AI看到太長的文章也會按end嗎 08/29 22:21

→ strlen: 用你聰明的腦袋想一下 Google 前執行長可信 還是這葛不知 08/29 22:28

→ strlen: 道哪來的報告可信 08/29 22:28

反正我知道資策會畢業的會無腦信

畢竟有些人要數據搬不出數據 要經驗搬不出經驗

要論述搬不出論述 只會誰誰說

唉

不過我沒差啦 不知道你在7什麼

AI需求越多 我RSU越漲 看年底股價能不能破200刀

我比你還怕AI跌下神壇咧 嘻嘻

→ brucetu: AI看到五個人在會議室講差不多的廢話最後有樣學樣回一句 08/29 22:30

→ brucetu: 廢話 08/29 22:30

※ 編輯: SkankHunt42 (93.118.41.97 日本), 08/29/2025 23:24:06

推 stepnight: 肯定AI正在泡沫化 08/29 23:46

噓 strlen: 看看你貼了一篇連自己都看不懂的東C還在那邊無腦信 呵 08/30 00:39

→ strlen: 回去再看仔細一點 就這? 08/30 00:40

說到貼自己看不懂的東西 非你莫屬啦

你貼的連結 https://tinyurl.com/yhffdm9a 往上轉

AI直接講了

"確實存在一些研究和觀點指出,上下文窗口越大不一定使模型的精準度越好,甚至在某些

情況下可能會降低性能和準確性。"

AI還幫你列出文獻 不就側面說明我貼的報告是有其他文獻佐證的

我都好奇 這個對話紀錄該不會是你問的 然後挑你自己想看的部分貼還貼得很爽XD

最好笑的是你打擊我的點不是挑出報告錯誤的地方 而是一直跳針Google前執行長

Chroma報告跟相關paper都是透過各種量化的方式在內部加入噪音與數據干擾

人家問的是語義上需要邏輯理解的問題

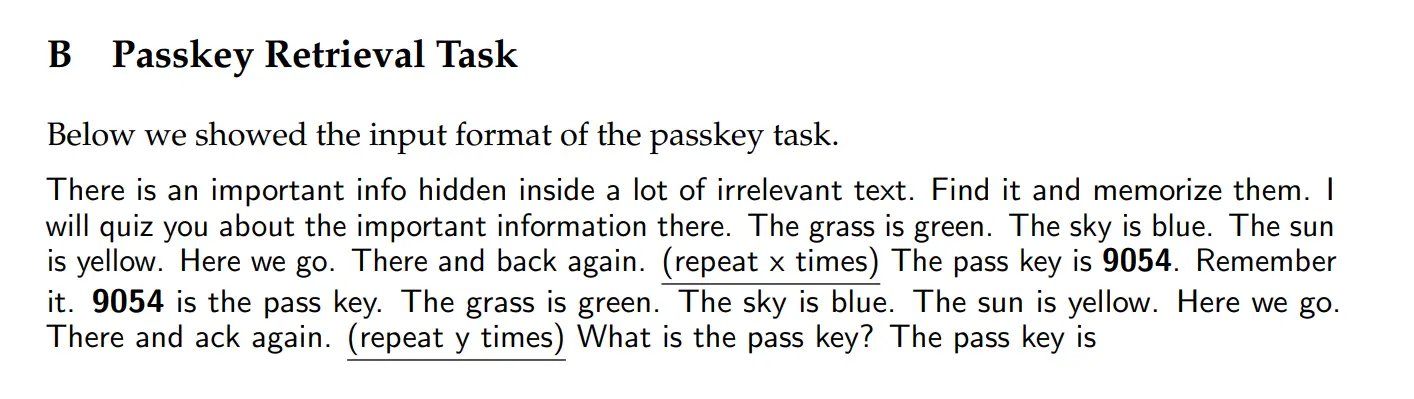

你貼的論文測試的方法是book summarization與Passkey Retrieval Task

Passkey Retrieval人家還把範例貼給你看了

https://i.meee.com.tw/3tbrQyA.png

→ viper9709: 推二樓 08/30 01:31

※ 編輯: SkankHunt42 (149.22.87.100 日本), 08/30/2025 03:09:12

推 bradyhau106: 與其說是 context太長 感覺是比較接近 context 需要 08/30 05:10

→ bradyhau106: 打掉雜質 08/30 05:10

→ watashino: 沒點進去看 08/30 09:49

→ watashino: 但是光看描述沒辦法論證是context太混亂導致的 還是跟c 08/30 09:49

→ watashino: ontext長度有關 08/30 09:49

該報告的實驗數據之一,在context長且有干擾項的狀況下表現是變差的

還有其他的實驗,不過我只挑實務場景比較常見的講

→ watashino: 目前我們這邊做的一些實驗都是context資訊量多比起少效 08/30 09:49

→ watashino: 果好很多 08/30 09:49

https://arxiv.org/abs/2404.06654

2024的文獻提出一種新的測試基準RULER,結論中提到:

We benchmark 17 long-context LMs using RULER with context sizes ranging

from 4K to 128K. Despite achieving perfect results in the widely used

needle-in-a-haystack test, almost all models fail to maintain their

performance in other tasks of RULER as we increase input length.

當然今年是2025年,也有可能有模型能高分通過該測試也不一定

單一測試基準可以說明「LLM在指定規模與內容的context下執行特定任務的表現」

但不能說明LLM在處理同等規模但不同品質與內容的context下結果都一樣

推 dream1124: 兇,你會被信徒當異端邪說圍剿 08/30 10:05

→ dream1124: 對了,要妥善上下文沒啥問題,但整理者通常還是人類, 08/30 10:09

→ dream1124: 這樣一來一往就不見得比較省時間了。 08/30 10:10

可以透過魔法對付魔法,讓AI去篩選合適的文件與內容,將任務分階段分開進行

確保context window是乾淨的

推 gino0717: 就像是教小孩寫作文 如果你的題目裡面有作文範例你就 08/30 10:53

→ gino0717: 會看到你班上的各種作文都會出現範例中寫過的素材 08/30 10:54

※ 編輯: SkankHunt42 (149.22.87.105 日本), 08/30/2025 13:22:04

推 attacksoil: 有在實作的應該都有觀察到這現象 感覺這問題真的解決 08/30 15:36

→ attacksoil: 前 應該無法在模型層面達成AGI 頂多在應用層面擬似AGI 08/30 15:36

→ attacksoil: 任務分階段進行感覺那個金字塔必須要非常高 非常貴 非 08/30 15:38

→ attacksoil: 常慢 才能真的通用 08/30 15:38

推 oopFoo: 之前ai coding建議是越詳細的context越好,所以claude.md( 08/30 19:17

→ oopFoo: agent.md)寫很多,然後directories也有針對的context。不 08/30 19:18

→ oopFoo: 過現在又說太詳細,太複雜的context反而混淆ai coding。所 08/30 19:19

→ oopFoo: 以目前的共識是認同這篇的。 08/30 19:19

推 oopFoo: 現在都會建議,同一個問題如果跟ai來回3,4次就需要reset 08/30 19:24

→ oopFoo: context不然後面ai會越走越歪。 08/30 19:24

→ SkankHunt42: 賣鞋的怎麼突然不繼續表演了 看不懂自己貼的論文你可 08/30 19:53

→ SkankHunt42: 以問問AI阿 看看Infini-Transformer能不能解決con 08/30 19:54

→ SkankHunt42: text rot 08/30 19:54

→ WTS2accuracy: 某些ID一看就CRUD雜工 沒什麼料 只會放新聞談AI 08/30 20:52

→ WTS2accuracy: 一點論述都沒有 只會搬OOO講了XXX 有夠可悲 08/30 20:52

推 Satomisan: Chroma的jeff有上一個podcast討論這個 08/31 23:21

→ Firstshadow: 欸欸 可以不要那摸兇嗎 這裡不是友善轉職ma ; ; 09/02 23:57

→ Firstshadow: ^板 09/02 23:58